Indice dei contenuti

Face ID autorizza il riconoscimento facciale per autentificare il possessore di iPhone X, il nuovo top di gamma della Apple. Ecco come funziona

![]()

![]()

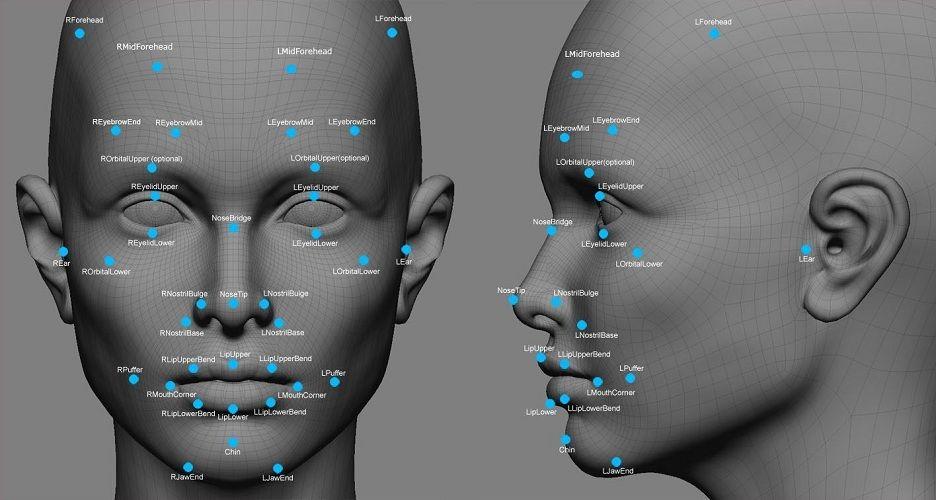

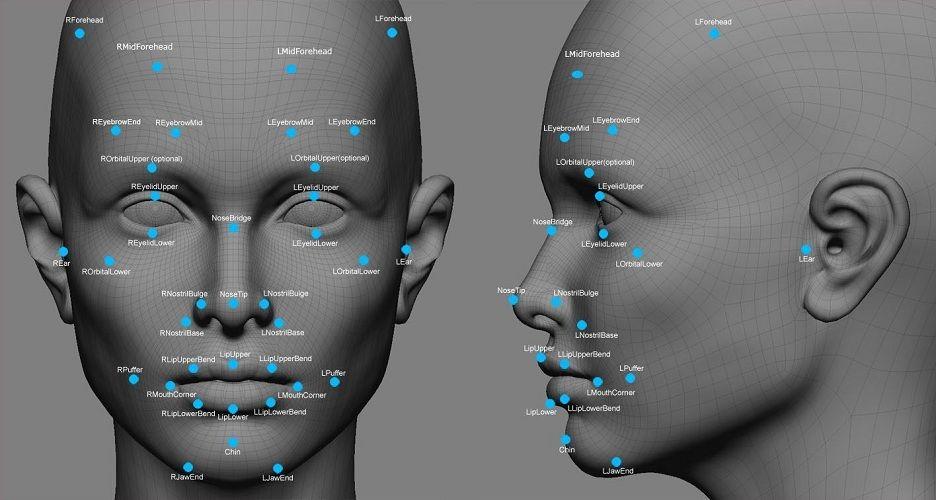

La novità più attesa di iPhone X è di sicuro Face ID, ossia il riconoscimento facciale per l’autentificazione del possessore del nuovo terminale. Obiettivo di questa guida è pertanto quella di spiegare come funziona Face ID su iPhone X, stando anche a quanto Apple ha già anticipato il 12 settembre, in occasione del keynote allo Steve Jobs Theatre.

Il funzionamento di Face ID su iPhone X: il ruolo della fotocamera TrueDepth

Il possessore di iPhone X potrà sbloccare il suo dispositivo con Face ID, grazie alla fotocamera TrueDepth. Quest’ultima dovrà solo “vedere” il volto dell’utente, a prescindere dalla prospettiva. Da Cupertino, però, fanno sapere che la distanza ottimale è tra i 25 e i 50 cm dal viso. Come si attiva TrueDepth? Basta sollevare iPhone X oppure visualizzare una notifica. Nel momento in cui il top di gamma della Apple viene sbloccato, si verifica l’autentificazione del possessore tramite fotocamera o meglio mediante confronto tra i dati di profondità e l’immagine a infrarossi archiviata in precedenza. Per ciò che concerne questa rappresentazione matematica già immagazzinata, si è molto dibattuto in ottica sicurezza. Come si sa, la protezione dei dati e la sicurezza delle informazioni è da sempre uno dei cavalli di battaglia di Apple e, per questo motivo, si è ricorso alla cifratura di questi parametri che vengono anche protetti tramite una chiave, a cui è possibile avere accesso esclusivamente dal Secure Enclave. Cos’è quest’ultimo? Un co-processore presente nelle CPU Apple Serie S2, A7 e successive. Per concludere, Face ID resta unicamente associato al terminale del possessore ed non c’è mai il backup su iCloud.

Può una persona, diversa dal possessore, sbloccare iPhone X tramite Face ID?

A Cupertino sostengono che la la probabilità sia inferiore a 1 su 1.000.000. Bisogna tenere conto che vi sono gemelli, fratelli somiglianti e minori di 13 anni che non hanno ancora sviluppato appieno i tratti distintivi del viso. Trattasi comunque di un ottimo dato, se si considera che per Touch ID, il lettore di impronte digitali, era di “appena” 1 su 50.000. Per tenere alto il livello di sicurezza, su Face ID vi sono massimo 5 tentantivi di accesso. In caso di esito negativo, occorrerà inserire il codice.

E’ poi importante tenere presente che il riconoscimento del viso avviene solo se gli occhi sono aperti e se sono inquadrati dalla fotocamera del dispositivo. E’ molto ma molto difficile sbloccare iPhone X all’insaputa del diretto interessato, quando ad esempio sta dormendo.

Quand’è che Face ID chiede la password?

- Occorre inserire il codice nei seguenti casi:

- iPhone X non viene sbloccato da oltre 48 ore

- E’ stata effettuata l’accensione di iPhone X

- E’ stato effettuato il riavvio di iPhone X

- Per 5 volte si è provato a sbloccare il terminale senza successo

- Face ID non è stato utilizzato nelle ultime 4 ore

- Non è stato utilizzato il codice per lo sblocco di iPhone X negli ultimi 6 giorni

Se iPhone X viene perso o rubato, si può impedire che Face ID venga utilizzato da un malintenzionato per sbloccare il terminale. Come? Basta impostare il terminale in modalità “Smarrito” con “Trova il mio iPhone”.

Si noti che Face ID è in grado di adattarsi in automatico alle modifiche dell’aspetto dei possessori di iPhone X: un cambio di barba (o il taglio della barba), il makeup, gli occhiali da sole, le lenti a contatto, il cappello non rappresentano alcun ostacolo in fase di riconoscimento del volto.

Per concludere, Face ID va ben oltre il Touch ID che, già di suo, aveva apportato una vera e propria rivoluzione per l’autentificazione, mediante riconoscimento dell’impronta digitale. Riuscirà il riconoscimento facciale su iPhone X a bypassare il concetto di password? In molti sono ottimisti a riguardo. Per approfondire l’argomento, vi rimandiamo alla lettura del post “iPhone X rivoluziona il concetto di password: l’importanza del riconoscimento facciale”.